附录F Hadoop安装

F.1 在Ubuntu中环境准备

Hadoop支持在Linux、Windows、Mac上进行开发,但很难实现在Window和Mac大规模部署,我在这里也重点介绍Hadoop在Linux Ubuntu系统中的安装和使用。

由于Hadoop是用Java开发的,因此我们需要先安装好Java的环境,Java的安装请参考附录A。Hadoop没有提供apt的软件源安装,我们需要自己去官方网络下载Hadoop软件包进行安装。Hadoop的下载页是http://hadoop.apache.org/#Download+Hadoop。系统环境是:

Linux Ubuntu 12.04.2 LTS 64bit server

- Java JDK 1.6.0_45

F.2 找到Hadoop历史版本

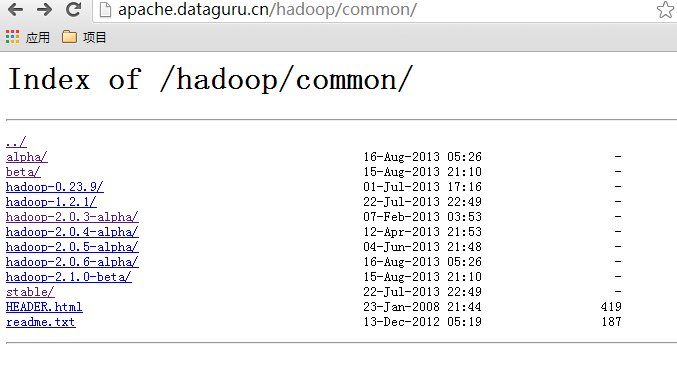

这里我们需要安装Hadoop的版本是1.1.2。打开Hadoop的下载页面http://www.apache.org/dyn/closer.cgi/hadoop/common/。随便打开一个下载镜像,我们都找不到1.1.2这个版本,如图F-1所示。

图F-1 Hadoop镜像

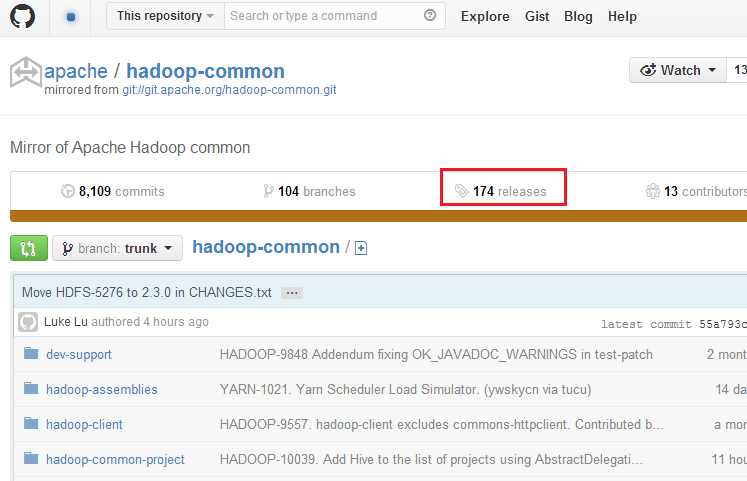

再去看看github上Hadoop发布源的情况,如图F-2所示。找到release-1.1.2

https://github.com/apache/hadoop-common/releases/tag/release-1.1.2

用Linux命令wget下载源代码:

~ wget https://github.com/apache/hadoop-common/archive/release-1.1.2.tar.gz

在github上面,查看branch-1.1

https://github.com/apache/hadoop-common/tree/branch-1.1

F.3 用源代码构建Hadoop环境

Linux系统环境:

- Linux Ubuntu 64bit Server 12.04.2 LTS

- Java 1.6.0_29

- Ant 1.8.4

注:github上面最新hadoop-3.0.0-SNAPSHOT,包结构已经完全改变,用Maven代替了Ant + Ivy的构建过程。

F.3.1 安装Hadoop

~ tar xvf release-1.1.2.tar.gz

~ mkdir /home/conan/hadoop/

~ mv hadoop-common-release-1.1.2 /home/conan/hadoop/

~ cd /home/conan/hadoop/

~ mv hadoop-common-release-1.1.2/ hadoop-1.1.2

查看hadoop目录

~ cd hadoop-1.1.2

~ ls -l

drwxrwxr-x 2 conan conan 4096 Mar 6 2013 bin

-rw-rw-r-- 1 conan conan 120025 Mar 6 2013 build.xml

-rw-rw-r-- 1 conan conan 467130 Mar 6 2013 CHANGES.txt

drwxrwxr-x 2 conan conan 4096 Oct 3 02:31 conf

drwxrwxr-x 2 conan conan 4096 Oct 3 02:28 ivy

-rw-rw-r-- 1 conan conan 10525 Mar 6 2013 ivy.xml

drwxrwxr-x 4 conan conan 4096 Mar 6 2013 lib

-rw-rw-r-- 1 conan conan 13366 Mar 6 2013 LICENSE.txt

drwxrwxr-x 2 conan conan 4096 Oct 3 03:35 logs

-rw-rw-r-- 1 conan conan 101 Mar 6 2013 NOTICE.txt

-rw-rw-r-- 1 conan conan 1366 Mar 6 2013 README.txt

-rw-rw-r-- 1 conan conan 7815 Mar 6 2013 sample-conf.tgz

drwxrwxr-x 16 conan conan 4096 Mar 6 2013 src

在根目录下面,没有hadoop-*.jar的各种类库,也没有依赖库。

F.3.2 执行Ant进行编译

从官方网站下载Ant:http://ant.apache.org/bindownload.cg。

~ wget http://archive.apache.org/dist/ant/binaries/apache-ant-1.8.4-bin.tar.gz

~ tar xvf apache-ant-1.8.4-bin.tar.gz

~ mkdir /home/conan/toolkit/

~ mv apache-ant-1.8.4 /home/conan/toolkit/

~ cd /home/conan/toolkit/

~ mv apache-ant-1.8.4 ant184

设置ant到环境变量

~ sudo vi /etc/environment # 编辑environment文件

PATH="/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/home/conan/toolkit/jdk16/bin:/home/conan/toolkit/ant184/bin"

JAVA_HOME=/home/conan/toolkit/jdk16

ANT_HOME=/home/conan/toolkit/ant184

~ . /etc/environment #让环境变量生效

~ ant #运行ant命令,检查环境变量是否配置成功

Buildfile: build.xml does not exist!

Build failed

用Ant编译Hadoop

~ sudo apt-get install autoconf # 安装编译用的库

~ sudo apt-get install libtool

~ cd /home/conan/hadoop/hadoop-1.1.2/ # 用Ant编译Hadoop

~ ant

要等几分钟,然后build成功。下面查看生成的build目录。

~ ls -l build

drwxrwxr-x 3 conan conan 4096 Oct 3 04:06 ant

drwxrwxr-x 2 conan conan 4096 Oct 3 04:02 c++

drwxrwxr-x 3 conan conan 4096 Oct 3 04:05 classes

drwxrwxr-x 13 conan conan 4096 Oct 3 04:06 contrib

drwxrwxr-x 2 conan conan 4096 Oct 3 04:05 empty

drwxrwxr-x 2 conan conan 4096 Oct 3 04:02 examples

-rw-rw-r-- 1 conan conan 423 Oct 3 04:05 hadoop-client-1.1.3-SNAPSHOT.jar

-rw-rw-r-- 1 conan conan 4035744 Oct 3 04:05 hadoop-core-1.1.3-SNAPSHOT.jar

-rw-rw-r-- 1 conan conan 426 Oct 3 04:05 hadoop-minicluster-1.1.3-SNAPSHOT.jar

-rw-rw-r-- 1 conan conan 306827 Oct 3 04:05 hadoop-tools-1.1.3-SNAPSHOT.jar

drwxrwxr-x 4 conan conan 4096 Oct 3 04:02 ivy

drwxrwxr-x 3 conan conan 4096 Oct 3 04:02 src

drwxrwxr-x 6 conan conan 4096 Oct 3 04:02 test

drwxrwxr-x 3 conan conan 4096 Oct 3 04:05 tools

drwxrwxr-x 9 conan conan 4096 Oct 3 04:02 webapps

发现hadoop-.jar都是hadoop--1.1.3-SNAPSHOT.jar结尾的,合理的解释就是:上一个版本的release就是下一个版本的SNAPSHOT。我们修改文件build.xml第31行,让属性version的value为1.1.2,这样生成出来的包名就会变成hadoop-*-1.1.2.jar,再重新启动ant。

~ vi build.xml

<property name="version" value="1.1.2"/>

~ rm -rf build

~ ant

~ cp build/*.jar . #把生成的hadoop-*-1.1.2.jar复制到根目录

这个就生成好了hadoop环境,而且这个hadoop环境和我们之前下载的一样。

F.4 快速Hadoop配置环境脚本

我们按照下面的7个步骤进行配置:配置环境变量,设置Hadoop的3个配置文件,创建Hadoop目录,配置hostname和hosts,生成SSH免登陆,第一次启动格式化HDFS, 启动Hadoop的服务。

(1) 配置系统环境变量。

~ sudo vi /etc/environment

PATH="/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/home/conan/toolkit/jdk16/bin:/home/conan/toolkit/ant184/bin:/home/conan/toolkit/maven3/bin:/home/conan/toolkit/tomcat7/bin:/home/conan/hadoop/hadoop-1.1.2/bin"

JAVA_HOME=/home/conan/toolkit/jdk16

ANT_HOME=/home/conan/toolkit/ant184

MAVEN_HOME=/home/conan/toolkit/maven3

HADOOP_HOME=/home/conan/hadoop/hadoop-1.1.2

HADOOP_CMD=/home/conan/hadoop/hadoop-1.1.2/bin/hadoop

HADOOP_STREAMING=/home/conan/hadoop/hadoop-1.1.2/contrib/streaming/hadoop-streaming-1.1.2.jar

~ . /etc/environment #让环境变量生效

(2) 设置Hadoop的3个配置文件。

#core-site.xml

~ vi conf/core-site.xml

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://master:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/home/conan/hadoop/tmp</value>

</property>

<property>

<name>io.sort.mb</name>

<value>256</value>

</property>

</configuration>

#hdfs-site.xml

~ vi conf/hdfs-site.xml

<configuration>

<property>

<name>dfs.data.dir</name>

<value>/home/conan/hadoop/data</value>

</property>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

</configuration>

#mapred-site.xml

~ vi conf/mapred-site.xml

<configuration>

<property>

<name>mapred.job.tracker</name>

<value>hdfs://master:9001</value>

</property>

</configuration>

(3) 创建Hadoop目录

~ mkdir /home/conan/hadoop/data

~ mkdir /home/conan/hadoop/tmp

~ sudo chmod 755 /home/conan/hadoop/data/

~ sudo chmod 755 /home/conan/hadoop/tmp/

(4) 配置hostname和hosts

~ sudo hostname master

~ sudo vi /etc/hosts

192.168.1.210 master

127.0.0.1 localhost

(5) 生成SSH免登陆密钥

~ ssh-keygen -t rsa

~ cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

(6) 第一次启动格式化HDFS

~ bin/hadoop namenode -format

(7) 启动Hadoop的服务。

~ jps

15574 DataNode

16324 Jps

15858 SecondaryNameNode

16241 TaskTracker

15283 NameNode

15942 JobTracker

查看Hadoop节点的运行情况。

~ bin/hadoop dfsadmin -report

F.4 为Window环境编译hadoop-core.jar

在win环境开发中,经常会遇到一个错误权限检查的异常,我们需要修改FileUtil.java文件,注释688行--693行。

~ vi src/core/org/apache/hadoop/fs/FileUtil.java

685 private static void checkReturnValue(boolean rv, File p,

686 FsPermission permission

687 ) throws IOException {

688 /* if (!rv) {

689 throw new IOException("Failed to set permissions of path: " + p +

690 " to " +

691 String.format("%04o", permission.toShort()));

692 }

693 */

694 }

用ant重新打包后,就生成了可以在Window环境中运行的hadoop-core-1.1.2.jar!于是单节点的Hadoop,我们已经成功能安装在Linux Ubuntu系统中。